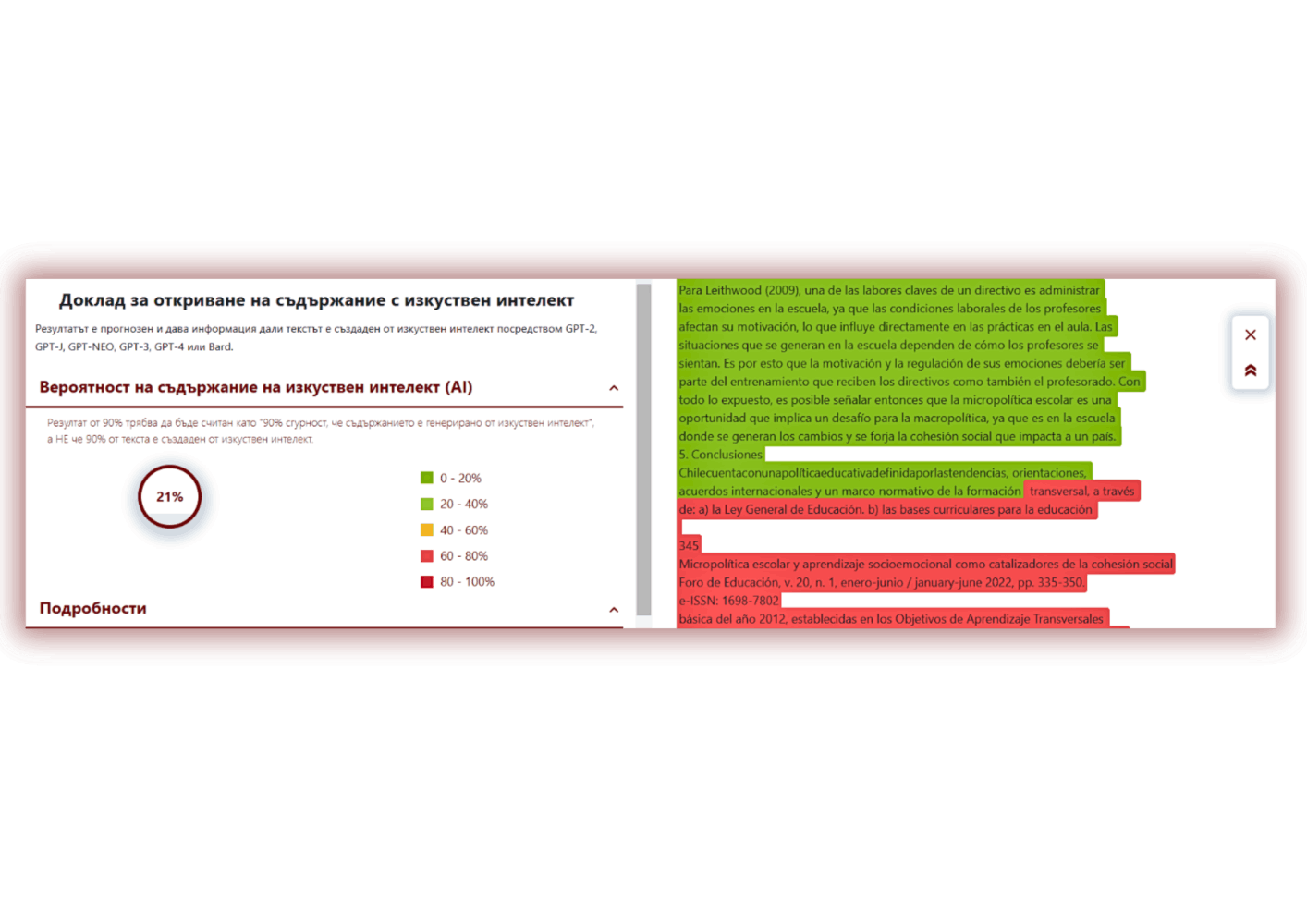

Модул за търсене на съдържание, генерирано от изкуствен интелект

Забелязахме, че студентите и преподавателите активно използват различни механизми и инструменти за създаване на съдържание, включително и изкуствен интелект.

Инструментите за генериране на съдържание от ИИ станаха част от образователния процес, въпреки че се появиха съвсем наскоро. Студентите и преподавателите ги използват, защото са много ефективни, бързи и имат достъп до огромни обеми информация. Въпреки това съществува известен риск, свързан с използването им.